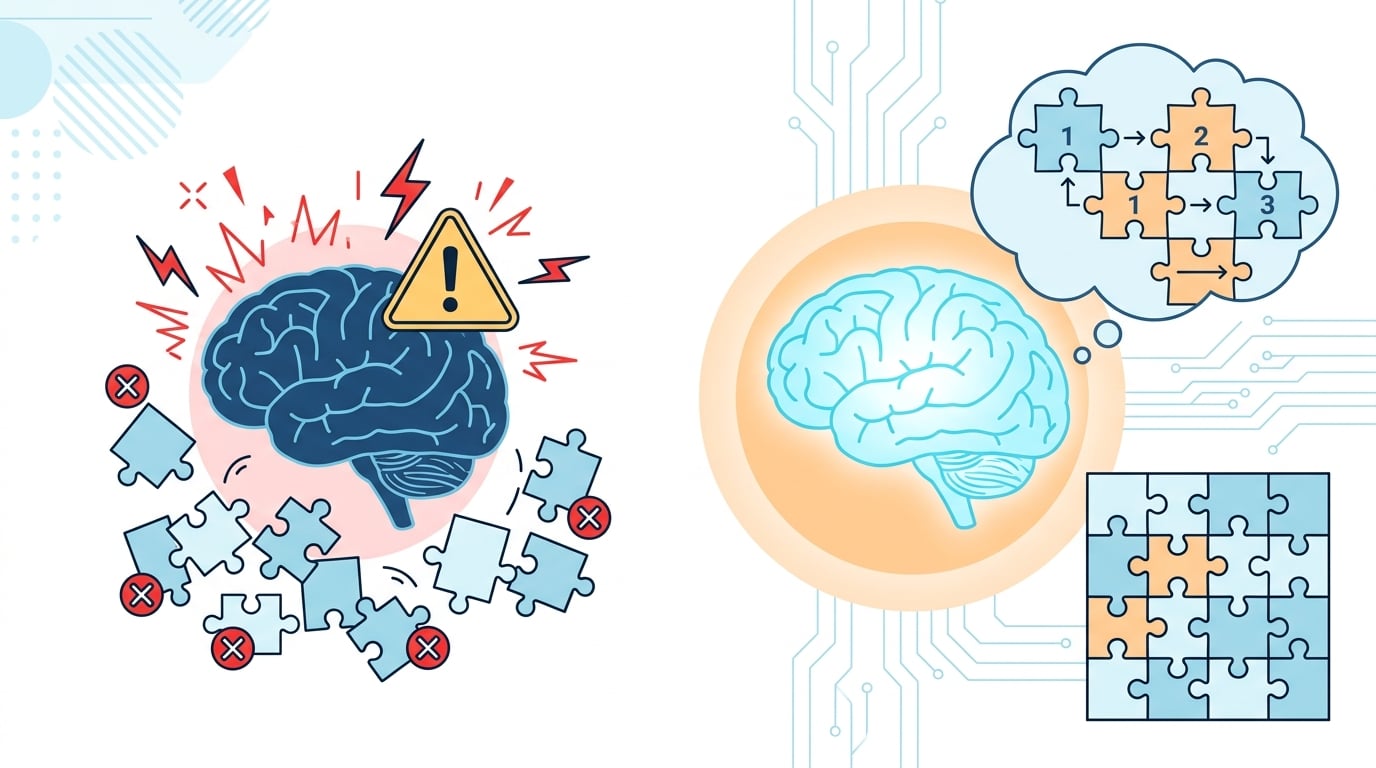

ปัญหาของการกระทำแบบตาบอด

เมื่อแก้ปัญหาตรรกะที่ซับซ้อนหรือดึงข้อมูลหลายชิ้น ถ้าบังคับให้ระบบปัญญาประดิษฐ์ตัดสินใจเลือกการกระทำทันที จะนำไปสู่ข้อผิดพลาดที่ร้ายแรงได้

ลองคิดดูว่ามนุษย์แก้ปัญหาภาพจิ๊กซึ่งอย่างไร:

- พวกเขาไม่ได้หยิบชิ้นส่วนมาอย่างสุ่มแล้วผลักใส่แผ่นกระดานทันที

- พวกเขาจะวางแผนทางความคิดหรือพูดออกมาเป็นคำพูด: "ก่อนอื่น ฉันต้องหามุมและขอบของภาพที่แบนราบก่อน แล้วค่อยดูว่าชิ้นสีฟ้าชิ้นนี้เข้ากันหรือไม่"

ในทางเดียวกัน หากเราเรียกใช้ระบบปัญญาประดิษฐ์โดย เพียงแค่ แสดงผลการกระทำเพียงอย่างเดียว โดยข้ามขั้นตอนการวิเคราะห์ มันจึงถือว่าเป็นการ 'กระทำแบบตาบอด' ซึ่งมักจะเดา หลอน หรือเลือกเครื่องมือผิดทั้งหมด เพราะยังไม่ได้วางแผนเงื่อนไขเบื้องต้นในการตอบคำถาม

คิดเสียงดัง

โมเดลภาษาสร้างตรรกะทีละคำ ด้วยการบังคับให้ระบบปัญญาประดิษฐ์ 'คิดเสียงดัง' (สร้างข้อความวิเคราะห์ปัญหา) ก่อนที่ จะเลือกการกระทำ เราจะมอบพื้นที่จำเป็นให้มันเพื่อไปสู่ข้อสรุปเชิงตรรกะที่ถูกต้อง